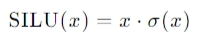

"SILU" 激活函数,也被称为"Swish"或"Sigmoid Linear Unit",是一种在深度学习中使用的激活函数。SILU函数的数学表达式为:

[ \text{SILU}(x) = x \cdot \sigma(x) ]

其中 ( x ) 是输入值,( \sigma(x) ) 是sigmoid函数,即:

[ \sigma(x) = \frac{1}{1 + e^{-x}} ]

SILU函数结合了线性和非线性特性,其输出范围在0到输入值 ( x ) 之间。SILU在某些情况下被证明对模型性能有益,特别是在处理具有大量参数的深度神经网络时。

SILU函数的一些关键特点包括:

- 自归一化:由于Sigmoid函数的输出范围在0到1之间,SILU函数的输出也被归一化到相同的范围内。

- 非单调:与ReLU(Rectified Linear Unit)等单调激活函数不同,SILU函数是非单调的,这意味着它可以更灵活地处理各种数据模式。

- 参数效率:在某些情况下,使用SILU可以减少模型所需的参数数量,从而提高效率。

然而,SILU函数并不总是适用于所有类型的网络或问题。选择激活函数通常取决于具体的应用场景和网络架构。在实践中,可能需要尝试不同的激活函数来找到最适合特定任务的那一个。